Fisikawan Inggris terkenal Stephen Hawking, dalam sebuah artikel yang diilhami oleh film fiksi ilmiah "Transcendence" yang dibintangi Johnny Depp, mengatakan bahwa meremehkan ancaman dari kecerdasan buatan bisa menjadi kesalahan terbesar dalam sejarah manusia.

Dalam sebuah artikel yang ditulis bersama dengan profesor ilmu komputer Stuart Russell dari Universitas California di Berkeley dan profesor fisika Max Tegmark dan Frank Wilczek dari MIT, Hawking menunjukkan beberapa kemajuan dalam kecerdasan buatan, dengan memperhatikan mobil yang dapat mengemudi sendiri, asisten suara Siri, dan superkomputer. pemenang pria dalam game kuis TV Jeopardy.

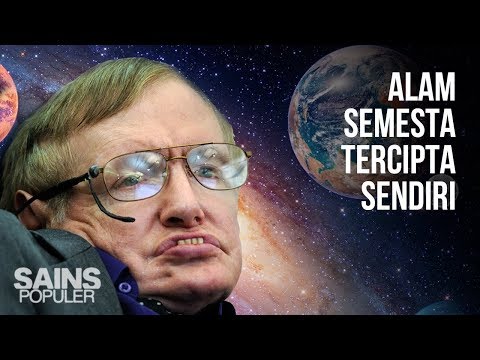

“Semua pencapaian ini pucat dengan latar belakang dari apa yang menanti kita dalam beberapa dekade mendatang. Penciptaan kecerdasan buatan yang berhasil akan menjadi peristiwa terbesar dalam sejarah manusia. Sayangnya, ini bisa menjadi yang terakhir, jika kita tidak belajar menghindari risiko,”kata Hawking dikutip oleh surat kabar Inggris The Independent.

Profesor menulis bahwa di masa depan mungkin terjadi bahwa tidak ada seorang pun dan tidak ada yang dapat menghentikan mesin dengan kecerdasan yang tidak manusiawi dari pengembangan diri. Dan ini akan meluncurkan proses yang disebut singularitas teknologi, yang berarti perkembangan teknologi yang sangat pesat. Dalam film dengan partisipasi Depp, kata "transendensi" digunakan dalam pengertian ini.

Bayangkan teknologi seperti itu melampaui manusia dan mendorong pasar keuangan, penelitian ilmiah, manusia, dan pengembangan senjata di luar pemahaman kita. Jika efek jangka pendek dari kecerdasan buatan bergantung pada siapa yang mengendalikannya, maka efek jangka panjangnya bergantung pada apakah kecerdasan tersebut dapat dikontrol atau tidak.

Sulit untuk mengatakan konsekuensi apa yang dapat ditimbulkan oleh kecerdasan buatan pada manusia. Hawking percaya bahwa hanya ada sedikit penelitian serius yang ditujukan untuk masalah ini di luar organisasi nirlaba seperti Pusat Studi Risiko Eksistensial Cambridge, Institut untuk Masa Depan Kemanusiaan, dan lembaga penelitian untuk kecerdasan mesin dan kehidupan masa depan.

Menurutnya, kita masing-masing harus bertanya pada diri sendiri apa yang bisa kita lakukan sekarang untuk menghindari skenario terburuk di masa depan.